9月10日,nvidia在发布专为大规模上下文处理打造的rubin cpx的同时,也揭晓了其下一代ai服务器架构,带来前所未有的规模与性能飞跃。

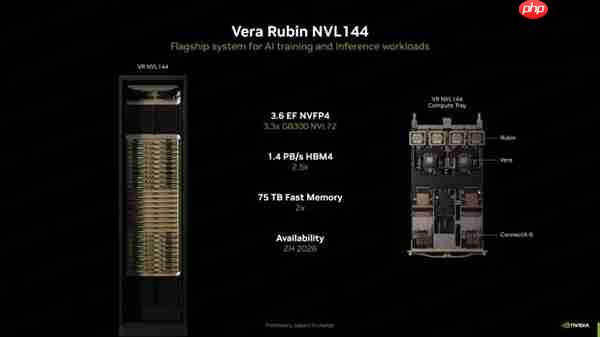

全新旗舰级AI服务器命名为“Vera Rubin NVL144”,专为高强度AI训练与推理任务设计。单个机架预计集成36颗Vera CPU和144颗Rubin GPU,并配备高达1.4PB/s带宽的HBM4内存(具体容量未披露),以及最高75TB的本地存储空间。

在NVFP4精度下,该系统的峰值算力可达3.5 EFlops,相当于每秒执行350亿亿次运算,相较前代GB300 NVL72系统实现3.3倍的性能提升!

而更强大的版本——“Vera Rubin NVL144 CPX”则额外增加了72颗Rubin CPX协处理器,构成单机架144颗GPU与36颗CPU的超级配置。

此版本还升级至1.7PB/s HBM4内存带宽、100TB高速存储,并支持Quantum-X800 InfiniBand或Spectrum-X以太网互联技术,搭配ConnectX-9 NIC网络接口卡,全面提升数据吞吐能力。

在NVFP4精度下,整机算力飙升至8 EFlops,即每秒800亿亿次计算,相比GB300 NVL72提升达7.5倍。

对于更高需求场景,该服务器支持双机架合并部署,资源配置与计算能力均可实现翻倍扩展。

NVIDIA宣称,凭借这一级别的AI基础设施,每投入1亿美元,有望产生高达50亿美元的经济回报。

根据NVIDIA最新路线图规划,Rubin GPU及其配套系统预计于2026年底开始交付,2027年推出增强版Rubin Ultra,而2028年将正式迈入下一代Feynman GPU时代,继续搭配Vera CPU平台演进。

以上就是NVIDIA宣布下代AI服务器:288颗GPU+36颗CPU 800亿亿次每秒的详细内容,更多请关注php中文网其它相关文章!

每个人都需要一台速度更快、更稳定的 PC。随着时间的推移,垃圾文件、旧注册表数据和不必要的后台进程会占用资源并降低性能。幸运的是,许多工具可以让 Windows 保持平稳运行。

Copyright 2014-2025 https://www.php.cn/ All Rights Reserved | php.cn | 湘ICP备2023035733号